¿Sigues soltando 25 euros al mes (IVA incluido, que nos conocemos) por una suscripción que te corta el grifo de mensajes cuando más la necesitas y te censura hasta el aire que respiras? Si la respuesta es sí, estás tirando el dinero.

En pleno 2026, depender de la nube de otros es de principiantes.

Hoy te voy a enseñar cómo montar tu propio búnker de Inteligencia Artificial utilizando Docker, LobeChat y Ollama. Sin cuotas, sin permanencias y con total privacidad.

Si tienes una GPU decente y ganas de dejar de ser un usuario pasivo, sigue leyendo. Esta es la guía definitiva para domar a la bestia desde tu propia casa.

El Motor: Ollama (Tu cerebro local)

Lo primero es lo primero: necesitamos un motor y Ollama es la herramienta que permite que los modelos de lenguaje más potentes del mercado corran directamente sobre tu hardware, aprovechando cada giga de tu tarjeta gráfica.

Comando Maestro: Abre tu CMD y escribe:

ollama pull qwen2.5-coder:7b

Deja que descargue; ahí tienes tu cerebro de nivel experto listo para trabajar.

Instalación: Ve a la web oficial y bájatelo. Es el típico instalador de «siguiente, siguiente, terminar«.

El Modelo «Claude-Killer»: Aunque no podemos bajar el código cerrado de Anthropic, tenemos algo mejor para programar y razonar: Qwen 2.5 Coder 7B.

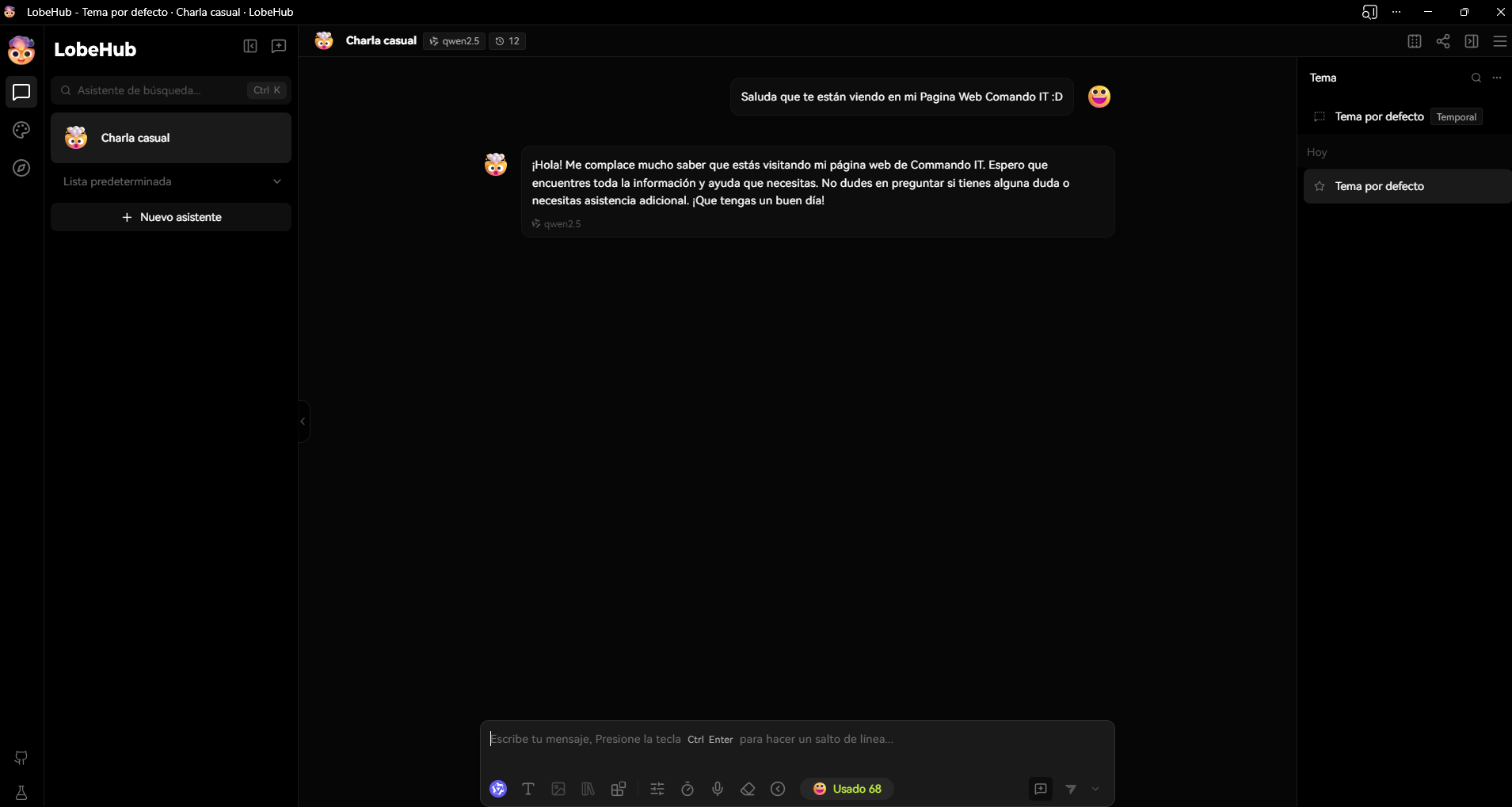

La Interfaz: LobeChat vía Docker

No queremos una terminal fea de los años 90. Queremos la experiencia premium. LobeChat es la interfaz que calca (y mejora) la experiencia de Claude, incluyendo los famosos Artifacts para visualizar código, webs o diagramas en tiempo real.

Para que la instalación sea limpia y no te ensucie Windows con archivos basura, vamos a usar Docker. Una vez instalado, abre tu CMD y lanza este comando que conecta la interfaz con tu PC:

docker run -d -p 3210:3210 --name lobe-chat -e OLLAMA_PROXY_URL=http://host.docker.internal:11434/v1 lobehub/lobe-chat

Con esto, ya tienes el «front-end» escuchando en el puerto 3210. Solo tienes que abrir tu navegador e ir a http://localhost:3210.

El Truco Maestro: Rompiendo las cadenas del Proxy

Aquí es donde la mayoría de los novatos se rinden y acaban volviendo a pagar la suscripción. Ollama, por defecto, es un tipo cerrado y no acepta conexiones que vengan de Docker. Si te sale un error de conexión o un «404 Not Found», es porque no has configurado las CORS.

Tienes que crear una variable de entorno en tu Windows llamada OLLAMA_ORIGINS con el valor *.

Esto le dice a Ollama: «Oye, acepta peticiones de mi interfaz local, que somos amigos«.

Reinicia Ollama tras hacerlo y verás cómo la magia ocurre.

Configuración Final y «Artifacts»

Dentro de LobeChat, vete a los ajustes de Modelos de Lenguaje, activa el interruptor de Ollama y dale al botón de refrescar. Si lo has hecho bien, aparecerá tu modelo en la lista.

Mira que bonito…. 😀

¿Por qué deberías hacer esto ya?

Montar este setup no es solo por ahorrarte los 300 euros al año que te gastarías en suscripciones. Es por el poder:

- Privacidad total: Tus datos no salen de tu casa. Ninguna multinacional va a usar tus ideas para entrenar su siguiente modelo.

- Sin límites: ¿Quieres generar 500 líneas de código a las 4 de la mañana? La IA no te va a decir que «has alcanzado tu límite de mensajes».

- Soberanía tecnológica: El hardware es tuyo, pagaste por él en la tienda, así que la IA también debería ser tuya.