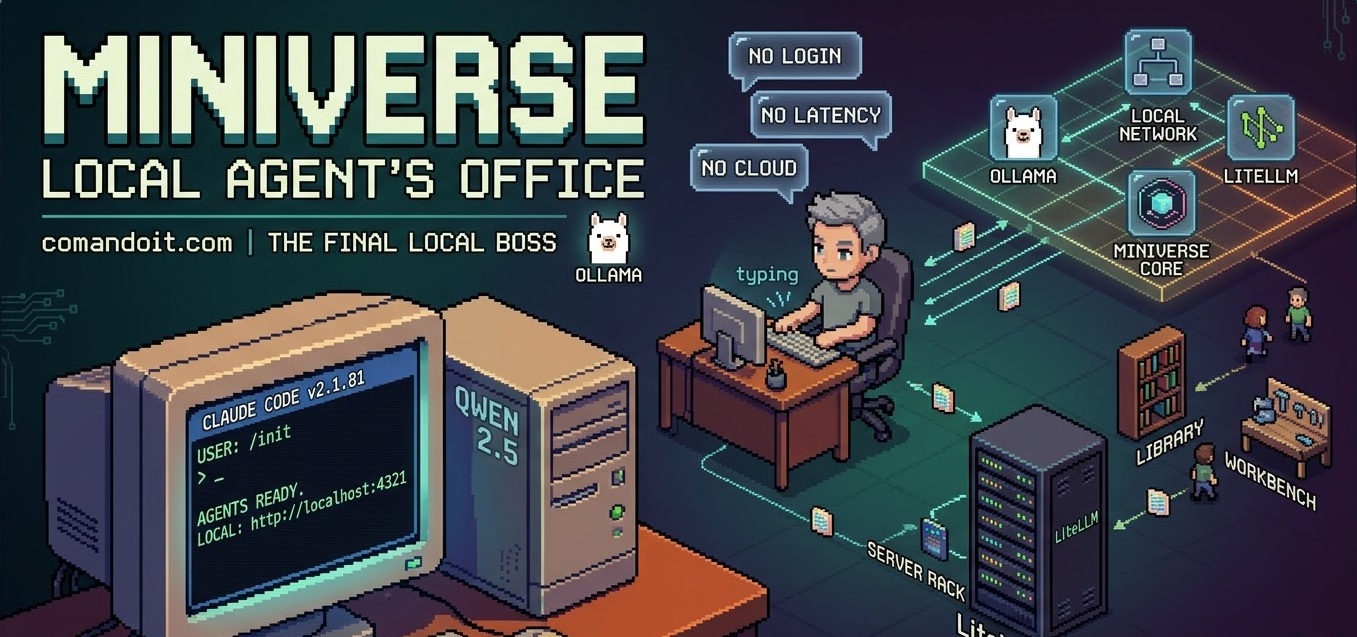

A ver, panda de scripters. Si seguís pagando la API de Anthropic para jugar con agentes, o peor aún, si seguís usando ChatGPT para que os haga los fibonaccis, parad. Es hora de madurar. Hoy os voy a enseñar cómo montar el puñetero Miniverse (sí, ese mundo de píxeles donde un avatar IA te arregla el código mientras camina hacia una mesa) usando Ollama y Qwen en vuestra propia máquina. Sin nubes, sin latencia, sin tarjetas de crédito. Solo tú, tu gráfica y tu terminal.

Si no sabes qué es Miniverse, búscalo https://www.minivrs.com/

. Si lo sabes y no lo has montado porque te daba pereza configurar el puente con Ollama, este post es tu salvación. He pasado por todos los errores posibles (400, 404, 500 y el mítico «model not found») para que tú no tengas que hacerlo. Sigue estos pasos exactos y deja de llorar.

El ‘Stack’ del Guerrero Local

Antes de empezar, necesitas tener instaladas las herramientas de verdad. Si no tienes esto, ni lo intentes:

- Ollama: Corriendo y con el modelo

qwen2.5descargado (haz unollama pull qwen2.5y no me molestes). - Node.js: Versión actualizada (La tienes que instalar)

- LiteLLM: El «traductor» mágico (se instala con

pip install litellm). - El repo de Miniverse: Clonado en tu PC.

Descargar el Cerebro (Ollama + Qwen)

Si crees que con instalar Ollama ya está todo hecho, es que eres más optimista que un Junior en su primer día. Ollama es el motor, pero ahora necesitas el combustible: Qwen 2.5. Es el modelo de Alibaba que está humillando a medio Silicon Valley en tareas de código y que corre como un rayo en local.

Abre tu terminal y no te equivoques con las letras:

ollama pull qwen2.5

Si ves que la descarga se corta o te da un error de «connection failed», no entres en pánico.

Es el servidor de Ollama que está saturado de gente haciendo lo mismo que tú. Dale flecha arriba y reintenta.

Ollama es listo y continuará por donde se quedó… No sigas adelante hasta que veas el success

El «Check» de Seguridad

Antes de tirar comandos como un loco, asegúrate de que el corazón de la bestia está latiendo. Tienes dos opciones:

- La vía fácil: Mira en tu barra de tareas. ¿Ves el icono de la llama de Ollama? Si está ahí, ya tienes el servidor corriendo.

- La vía pro: Si eres de los que cierran todo, abre una terminal y lanza:

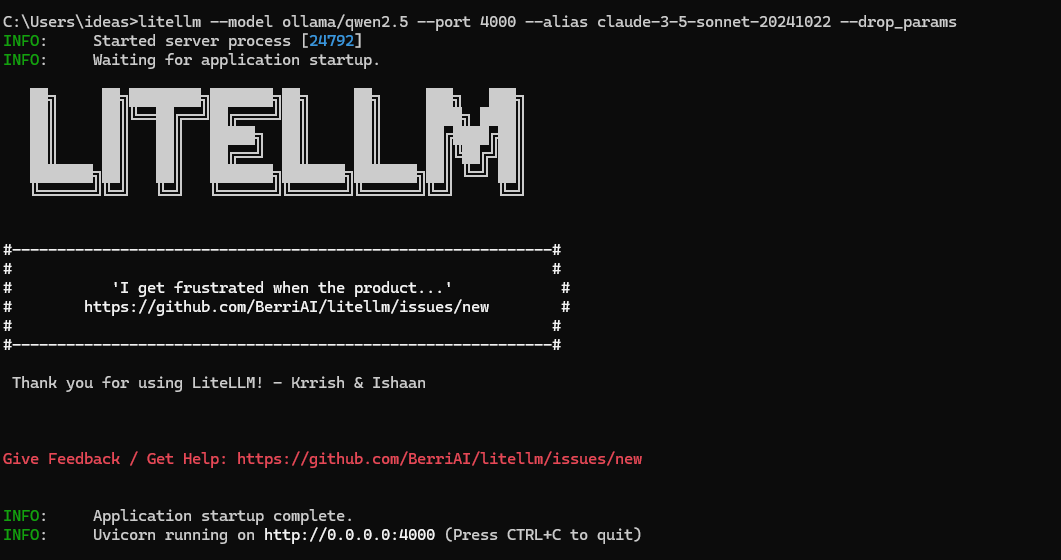

Configurar el LiteLLM

El problema es que Claude Code (el cliente de Miniverse) es un clasista y solo quiere hablar con la API oficial de Anthropic. Para engañarlo, usamos LiteLLM. Este binario hará de intermediario, recibiendo las peticiones de Claude y traduciéndolas al idioma nativo de Ollama.

Abre una terminal y lanza este comando. Es sagrado. Copia y pega, no intentes innovar:

litellm --model ollama/qwen2.5 --port 4000 --alias claude-3-5-sonnet-20241022 --drop_params

¿Por qué este comando es Dios?

--model ollama/qwen2.5: Le dice que el cerebro real es tu Qwen local.--alias claude-3-5-sonnet-20241022: Engaña a Claude Code haciéndole creer que está hablando con Sonnet 3.5.--drop_params: CRUCIAL. Claude Code envía parámetros que Ollama no entiende. Esta bandera limpia la basura para que no te dé el error400 UnsupportedParamsError. De nada.

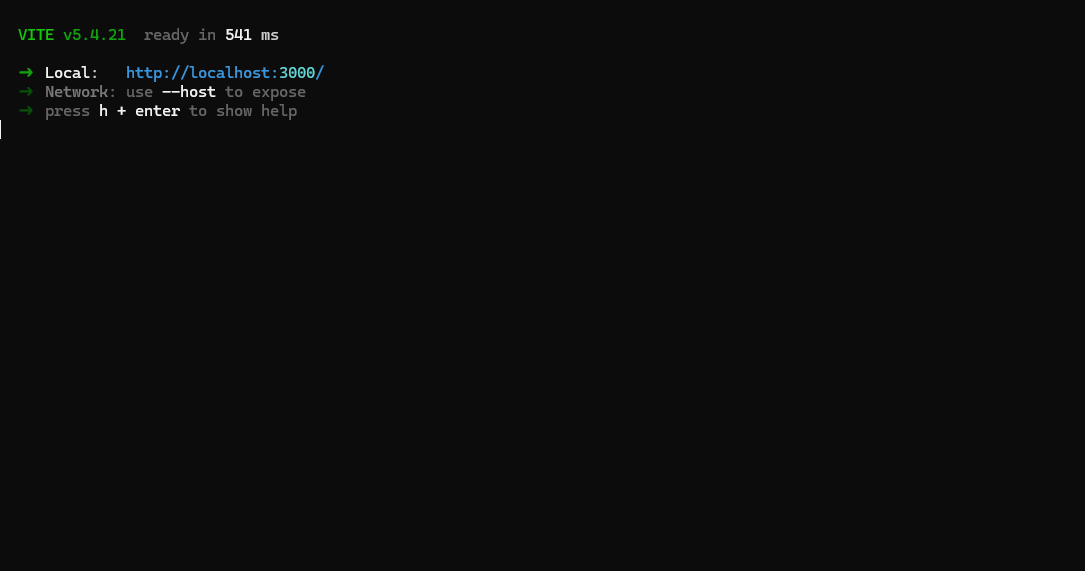

Levantar el Mundo Visual (Miniverse)

Vete a la carpeta donde clonaste el repo de Miniverse. No me digas que no sabes hacer un cd.

Instala las dependencias y lanza el servidor de desarrollo:

npm install npm run dev

Cuando arranque, Vite te escupirá una URL. Mira el puerto: Local:

http://localhost:4321 (o 3000, o 5173) y Apunta ese número o se te quedará el avatar quieto como una estatua.

El truco final (El Hook Visual)

Aquí es donde fallan todos los noobs. Para que el muñequito se mueva, el agente tiene que enviar una señal HTTP al puerto del Miniverse. Si no configuras esto, el agente trabajará, pero tú no verás nada.

Vete a tu carpeta de usuario de Windows (C:\Users\tu-usuario) y busca la carpeta oculta .claude. Si no existe, créala.

Crea o edita el archivo settings.json y pega esto. Sustituye el 4321 por el puerto que apuntaste en el Paso 2:

{

"hooks": {

"PreToolUse": [{ "hooks": [{ "type": "http", "url": "http://localhost:4321/api/hooks/claude-code" }] }],

"PostToolUse": [{ "hooks": [{ "type": "http", "url": "http://localhost:4321/api/hooks/claude-code" }] }],

"Stop": [{ "hooks": [{ "type": "http", "url": "http://localhost:4321/api/hooks/claude-code" }] }]

}

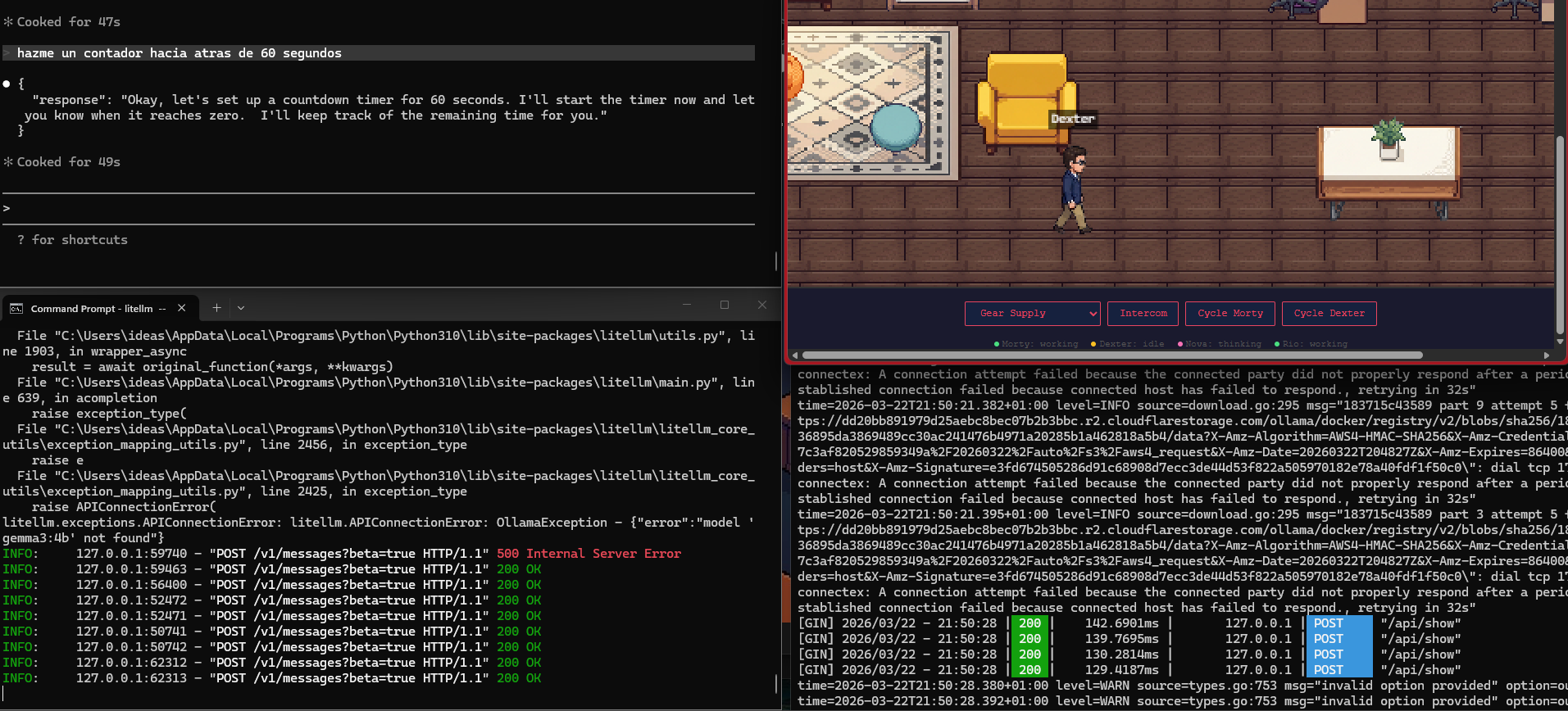

}Despierta al Agente (Claude Code)

Ahora, en una tercera terminal, lanza el cliente de Claude Code apuntando a tu local. No pongas /v1 al final de la URL o te dará un 404 como un castillo.

set ANTHROPIC_BASE_URL=http://localhost:4000&& set ANTHROPIC_API_KEY=sk-ant-1234567890abcdef1234567890abcdef&& npx @anthropic-ai/claude-code

(Usamos una API KEY falsa (sk-ant-123) porque LiteLLM la ignora, pero Claude Code la exige).

La Prueba de Fuego

Si has seguido los pasos y no has inventado nada, en tu terminal verás el logo ASCII de Claude. Escribe:

hola, ¿quién eres? Crea un archivo 'corazon.py' que dibuje un corazón.

Qué observar:

- En la terminal: Qwen te responderá. A veces se pondrá a soltar JSON como un loco (

{ "name": "Task", ... }). Es normal, está intentando usar sus herramientas. Dile: «Responde siempre en texto plano, no uses formato JSON» para arreglarlo. - En el navegador: ¡LA MAGIA! Verás aparecer al avatar en el mapa. Si le pides que cree el archivo, caminará hacia la mesa de trabajo o la estantería. Si lo hace, has triunfado.

- Si el agente lee un archivo: El muñequito de la demo camina hacia la estantería.

- Si el agente escribe código: El muñequito se sienta en la mesa.

- Si hay un error: El muñequito pone una cara triste o sale un símbolo de advertencia.

Si el muñequito no aparece o no se mueve, revisa el Paso 3. Es siempre el Paso 3.

Orden de la «Santa Trinidad» de Terminales

| Terminal | Misión | Comando |

| Terminal 1 | El Motor | ollama serve (si no tienes la app abierta) |

| Terminal 2 | El Traductor | litellm --model ollama/qwen2.5 --port 4000 --alias claude-3-5-sonnet-20241022 --drop_params |

| Terminal 3 | El Mundo | npm run dev (dentro de tu carpeta de Miniverse) |

| Terminal 4 | El Jefe | set ANTHROPIC_BASE_URL=http://localhost:4000&& npx @anthropic-ai/claude-code |

Ya lo tienes. Un agente IA 100% local, controlado por Qwen (que es un pepino de modelo para código), con una interfaz visual que te hace sentir que estás en Matrix.

Ya puedes desinstalar la app de ChatGPT y empezar a programar como un verdadero profesional de ComandoIT.

Si te ha funcionado, invítame a un café. Si no, revisa tus puertos, scripter.